Ciencia Computacional

} Las ciencias de la computación o ciencias de la informática son las ciencias formales que abarcan las bases teóricas de la información y la computación, así como su aplicación en los sistemas informáticos.123 El cuerpo de conocimiento de las ciencias de la computación es frecuentemente descrito como el estudio sistemático de los procesos algorítmicos que describen y transforman información: su teoría, análisis, diseño, eficiencia, implementación, algoritmos sistematizados y aplicación.4 En términos más específicos se trata del estudio sistemático de la factibilidad, estructura, expresión y mecanización de procedimientos metódicos (o algoritmos) que subyacen en la adquisición, representación, procesamiento, almacenamiento, comunicación y acceso a la información. La información puede estar codificada en forma de bits en una memoria de computadora, o en algún otro objeto, como los genes y proteínas en una célula biológica.5

Existen diversas ramas o disciplinas dentro de las ciencias de la computación; algunos resaltan los resultados específicos del cómputo (como los gráficos por computadora), mientras que otros (como la teoría de la complejidad computacional) se relacionan con propiedades de los algoritmos usados al realizar cómputo; y otros se enfocan en los problemas que requieren la implementación de sistemas informáticos. Por ejemplo, los estudios de la teoría de lenguajes de programación describen un cómputo, mientras que la programación de computadoras aplica lenguajes de programación específicos para desarrollar una solución a un problema computacional específico. Un computólogo se especializa en teoría de la computación y en el diseño e implementación de sistemas computacionales.6

Según Peter J. Denning, la cuestión fundamental en que se basa la ciencia de la computación es: «¿Qué puede ser (eficientemente) automatizado?».7

Historia[editar]

La historia de la ciencia de la computación antecede a la invención del computador digital moderno. Antes de la década de 1920, el término computador se refería a un ser humano que realizaba cálculos.8 Los primeros cimientos de lo que se convertiría en ciencias de la computación son anteriores a la invención de la computadora digital moderna. Se trataba de máquinas para el cálculo de las tareas numéricas fijas, como el ábaco han existido desde la antigüedad, ayudando en cálculos tales como la multiplicación y la división. Además, los algoritmos para realizar cálculos han existido desde la antigüedad, incluso antes de que se crearan equipos de computación sofisticados. Los antiguos sánscritos tratadistas Shulba Sutras, o "Reglas de la cuerda", es un libro de algoritmos escritos en 800 a. C. para la construcción de objetos geométricos como altares utilizando una clavija y cuerda, un precursor temprano del campo moderno de la geometría computacional.

Blaise Pascal diseñó y construyó la primera calculadora mecánica de trabajo, la Pascalina, en 1642.9 En 1673 Gottfried Leibniz creó una calculadora mecánica digital, llamada Stepped Reckoner.10 Él puede ser considerado el primer computólogo y teórico de la información, entre otras razones, porque fue el primero en documentar el sistema numérico binario. En 1820, Charles Xavier Thomas de Colmar lanzó la calculadora mecánica industrial11 cuando lanzó su simplificado aritmómetro, que fue la primera máquina de calcular lo suficientemente fuerte y lo suficientemente fiable para ser usada a diario en un entorno industrial. Charles Babbage inició el diseño de la primera calculadora automática mecánica, su máquina diferencial, en 1822, que finalmente le dio la idea de la primera calculadora mecánica programable, su máquina analítica.12 Él comenzó a desarrollar esta máquina en 1834 y en menos de dos años había esbozado muchas de las características más destacadas del moderno equipo. Un paso fundamental fue la adopción de un sistema de tarjetas perforadas derivado del telar de Jacquard13 haciéndolo infinitamente programable.14 En 1843, durante la traducción de un artículo francés sobre la máquina analítica, Ada Lovelace escribió, en una de las muchas notas que incluye el artículo, un algoritmo para calcular los números de Bernoulli, que es considerado como el primer programa de ordenador.15 Alrededor de 1885, Herman Hollerith inventó la máquina tabuladora, que usaba tarjetas perforadas para procesar información estadística; finalmente, su compañía se convirtió en parte de IBM. En 1937, cien años después del sueño imposible de Babbage, Howard Aiken fue convencido por IBM (que estaban manufacturando todo tipo de equipos de tarjetas perforadas y así como la calculadora de negocio 16) para desarrollar su calculadora programable gigante, el ASCC/Harvard Mark I. Se basó en la máquina analítica de Babbage, que a su vez utiliza las tarjetas perforadas y una unidad central de cálculo. Cuando se terminó de construir la máquina, algunas personas lo aclamaron como «el sueño de Babbage hecho realidad».17

Nuevas máquinas[editar]

Durante la década de 1940, conforme se desarrollaban las nuevas y más poderosas máquinas para computar, el término computador se comenzó a utilizar para referirse a las máquinas y ya no a sus antecesores humanos.18 Cuando se hizo evidente que las computadoras no solamente podrían utilizarse para realizar cálculos matemáticos, el campo de las ciencias de la computación se amplió para estudiar cómputo en general. Las ciencias de la computación empezaron a establecerse como una disciplina académica distinta de las demás en la década de 1950 y principios de 1960.719 Entonces surgió el primer programa de grado universitario del mundo, el Cambridge Diploma in Computer Science, del Cambridge Computer Lab (Departamento de Ciencias de la Computación) de la Universidad de Cambridge, en 1953. El primer programa de grado universitario en ciencias de la informática en Estados Unidos se formó en la universidad de Purdue en 1962.20 Desde que se dispone ordenadores prácticos, muchas aplicaciones la de las ciencias de la computación se convirtieron en diferentes áreas de estudio en sus propios términos.

Aunque inicialmente muchos creyeron que era imposible que las computadoras en sí mismas podrían constituir en realidad un campo científico de estudio, a finales de los años cincuenta se fue volviendo gradualmente aceptada entre la población mayor académica.2122

La disciplina científica de las ciencias de la computación nace a principios de 1940 con la confluencia de la teoría de algoritmos, lógica matemática y la invención del programa almacenado en una computadora electrónica.4 Ejemplos de esto son los trabajos de Alan Turing, Alonzo Church y Kurt Gödel en 1930 acerca de los algoritmos y su trabajo en sistemas de reglas (véase Cálculo Lambda, Máquina de Turing y Problemas Indecidibles), los algoritmos creados por Augusta Ada sesenta años antes, la computadora analógica construida por Vannevar Bush en 1920 y las computadoras eléctricas construidas por Howard Aiken y Konrad Zuse en 1930. Los escritos de John Von Neumann dieron una profundidad intelectual considerable a esta disciplina emergente a mediados de la década de 1940.

En 1960, había suficientemente cuerpo de conocimiento que ameritaba la creación de departamentos académicos y programas de grado universitario para esta disciplina.4 IBM es reconocida como la marca que formó parte de la revolución de las ciencias de la computación durante ese tiempo. IBM (abreviación de International Business Machines) lanzó la IBM 70423 y más tarde la IBM 70924 computadoras, que fueron ampliamente utilizadas durante el período de exploración de este tipo de dispositivos. "Sin embargo, el trabajo con la IBM [equipo] era frustrante ... si te equivocas en una letra de alguna instrucción, el programa se arruinaría, y se tendría que empezar todo el proceso otra vez".21 Durante la década de 1950, la disciplina de las ciencias de la computación estaba en su etapa de desarrollo, y estos problemas eran algo común.

El tiempo ha dado mejoras significativas en la capacidad de uso y la eficacia de la tecnología de la computación. La sociedad moderna ha presenciado un cambio significativo en los usuarios de la tecnología en cómputo, de ser utilizada únicamente por expertos, profesionales y científicos, a una base de usuarios que es casi omnipresente a la teoría con la cual se desarrolló y funciona este tipo de tecnología. Inicialmente, las computadoras eran bastante costosas, y era necesario un cierto grado de ayuda humana para el uso eficiente - en parte de operadores de computadoras profesionales. Como la adopción equipo se hizo más generalizado y asequible, se necesitaba menos asistencia humana en el uso común.

Mayores logros[editar]

A pesar de su corto tiempo de ser una disciplina científica formal, las ciencias de la computación han hecho un gran número de contribuciones importantes a la ciencia y la sociedad –de hecho, junto con la electrónica, es una ciencia fundacional de la época actual de la historia humana llamada Era de la información y la Revolución de la Información, visto como el tercer gran salto en el progreso tecnológico humano después de la Revolución Industrial (1750-1850) y la revolución neolítica (8000-5000 a. C.).

Estas contribuciones a la humanidad incluyen:

- El comienzo de la "Revolución digital", la cual incluye la actual Era de la información y el Internet.26

- Una definición formal de computación y computabilidad, y una demostración formal de que existen problemas que son computacionalmente irresolubles e intratables.27

- El concepto de lenguaje de programación, una herramienta para la expresión precisa de información metodológica a varios niveles de abstracción.28

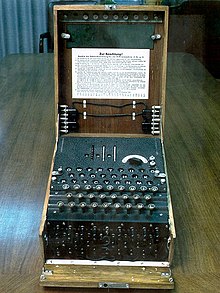

- En criptología, el criptoanálisis de Enigma fue un factor importante, el cual contribuyó a la victoria Aliada en la Segunda Guerra Mundial.25

- El cómputo científico permitió la evaluación de procesos y situaciones de gran complejidad, así como la experimentación mediante software. También permitió el avance en investigación de la mente humana y el mapeo del genoma humano junto el Proyecto Genoma Humano.26 Proyectos de cómputo distribuido tales como Folding@home que estudiaron el plegamiento de proteínas.

- Computación gráfica e imágenes generadas por computadora se volvieron omnipresentes en la era moderna del entretenimiento, sobre todo en televisión, cine, publicidad, animación y videojuegos. [cita requerida]

- Simulación de varios procesos, incluyendo dinámica de fluidos computacionales, sistemas físicos, eléctricos, electrónicos y de circuitos, así como las sociedades y las situaciones sociales (sobre todo juegos de guerra), junto con sus hábitats, entre muchos otros. Las computadoras modernas permiten la optimización de diseños tales como aviones completos. Se destaca el diseño de circuitos eléctricos y electrónicos con SPICE, así como software para la realización física de nuevos diseños. Este último incluye soporte lógico de diseño esencial para circuito integrados.

- La Inteligencia artificial (IA) es cada vez más importante, ya que se vuelve más eficiente y compleja con el paso del tiempo. Existen muchas aplicaciones de la IA, algunas se pueden ver en el hogar, tales como aspiradores robóticos. También está presente en los videojuegos y en el campo de batalla moderno en aviones no tripulados, sistemas antimisiles, y robots de apoyo para escuadrones.

Filosofía[editar]

Algunos científicos de la computación han argumentado a favor de la distinción de tres paradigmas diferentes en ciencias de la computación. Peter Wegner ha argumentado que esos paradigmas son la ciencia, la tecnología y las matemáticas.29 El grupo de investigación de Peter Denning argumentó que son la abstracción (modelado), y diseño. Amnon H. Eden lo describe como el «paradigma racionalista» (el cual trata a las ciencias de la computación como una rama de las matemáticas, la cual prevalece en ciencias de la computación teórica y principalmente emplea el razonamiento deductivo), el paradigma tecnocrático (que podría ser encontrado en enfoques ingenieriles, más prominente en la ingeniería de software) y el paradigma científico (que se enfoca a objetos relacionados con la computación desde la perspectiva empírica de las ciencias naturales identificable en algunas ramas de la inteligencia artificial).

A pesar de su primera proposición en 1956,22 la locución «ciencias de la computación» aparece en 1959 en un artículo de la revista Communications of the ACM (prestigiada publicación científica destinada a lectores con experiencia en todos los ámbitos de la computación y los sistemas de información),30 en el cual Louis Fein discute sobre la creación de una Escuela de Estudios de Posgrado en Ciencias Computacionales análoga a la creación de Harvard Business School en 1921,31 justificando el nombre con el argumento de que: Como la ciencia administrativa, el tema o área de conocimiento puede ser aplicado, es de carácter interdisciplinario y que cuenta con las características típicas de una disciplina académica.32Sus esfuerzos y los de otros, como el analista numérico George Forsythe, fueron recompensados: universidades pasaron a crear este tipo de programas de estudio, a partir de 1962 en Purdue.33 A pesar del nombre de esta disciplina académica, una cantidad significativa de tópicos en ciencias de la computación no involucran el estudio de las computadoras, por esta razón muchos nombres alternativos han sido propuestos.34

Algunos departamentos de universidades prefieren la locución «ciencias de la computación» para hacer énfasis en esta diferencia. El científico danés Peter Naur sugirió el término datología,35 para reflejar el hecho de que esta disciplina científica gira en torno a los datos y a al tratamiento de estos, mientras que no necesariamente involucra a las computadoras. La primera institución científica en usar el término fue el Departamento de Datología de la Universidad de Copenhague, fundado en 1969, con Peter Naur como profesor de datología. El término es usado en países escandinavos. En los primeros años de la computación, un número de terminus para los practicantes del campo de la computación fueron propuestos en la revista Communications of the ACM – turingeniero, turologo, hombre de los diagramas de flujo, matemático meta-aplicado, y epistemologo aplicado.36 Tres meses después en esa misma publicación científica, el término computólogo fue sugerido. El siguiente año en la misma publicación surgió el término hypologo.37 El término computica también ha sido sugerido.38 En Europa, términos derivados de traducciones de la expresión "automatic information" (e.g. "informazione automatica" en Italiano) or "información y matemáticas" son frecuentemente usados, e.g. informatique (francés), Informatik (alemán), Informática (Italia, Países Bajos), Informática (España y Portugal), informatika (lenguas eslavas) o pliroforiki (πληροφορική, que significa informática) en Griego. Palabras similares han sido adoptadas en algunos lugares del Reino Unido, por ejemplo en la Universidad de Edimburgo.39 Pero estas no reflejan el aspecto de la computabilidad, por esta razón en un contexto de investigación científica tanto académica como industrial el término ciencias de la computación es mayormente usado en publicaciones y conferencias científicas.

Reviewed by Juan carcamo

on

junio 08, 2023

Rating:

Reviewed by Juan carcamo

on

junio 08, 2023

Rating:

No hay comentarios.: